研究揭示AI对话方面的缺陷:不知道何时该插话

发布日期:2024-11-18 17:11 点击次数:150

IT之家 11 月 11 日消息,图夫茨大学的研究人员发现,大型语言模型在对话中的“插话”方面普遍表现不佳,这限制了它们的对话能力。

据IT之家了解,2024 年 11 月 12 日至 16 日在迈阿密举行的自然语言处理经验方法会议(EMNLP 2024)上,图夫茨大学的语言学和计算机科学研究人员将介绍一项研究,该研究揭示了人工智能对话能力的不足之处,并指出了改进其对话能力的可能途径。这项研究结果已发表在 arXiv 预印本服务器上。

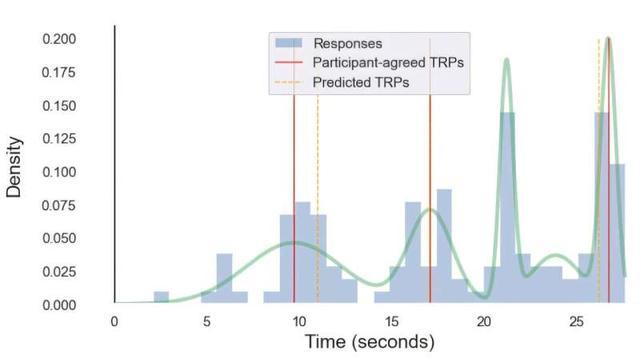

人类在对话中通常会避免同时说话,轮流发言和倾听。每个人都会评估许多输入线索,以确定语言学家所谓的“话轮转换点”(TRP),可以理解为插话的合适时机。TRP 在对话中经常出现,许多时候我们会略过一个 TRP,让说话者继续。其他时候,我们会利用 TRP 来轮流发言,分享我们的想法。

长期以来,人们认为对话中的“副语言”信息 —— 语调、单词和短语的延长、停顿和一些视觉线索 —— 是识别 TRP 最重要的信号。然而,图夫茨大学心理学和计算机科学教授 JP de Ruiter 表示,如果去掉单词,只给人们提供韵律 —— 就像你隔着袜子说话时传出的那种言语的旋律和节奏,他们就无法再察觉出合适的 TRP。

相反,如果只以单调的语音提供语言内容,研究对象将在其中找到大部分与自然语音中相同的 TRP。这表明,对话中轮流发言最重要的线索是语言内容本身,而停顿和其他线索并不那么重要。

人工智能擅长检测内容中的模式,但无法以接近人类的能力检测到合适的 TRP。

原因在于 AI 的训练数据。大型语言模型,包括最先进的 ChatGPT,都是基于互联网上的大量书面内容进行训练的,包括维基百科条目、在线讨论组、公司网站、新闻网站等。

这些数据集中缺少大量转录的口语对话,这些对话是即兴的,使用更简单的词汇和更短的句子,结构也与书面语言不同。AI 不是在对话中“成长”起来的,因此它没有能力以更自然、更人性化的方式建模或参与对话。

研究人员认为,可以通过对基于书面内容训练的大型语言模型进行微调,并用一小组对话内容进行额外训练,使其能够更自然地参与新的对话。然而,当他们尝试这样做时,发现仍然存在一些限制,无法完全复制人类般的对话。

研究人员警告称,AI 进行自然对话可能存在根本性的限制。它们是基于肤浅的统计相关性来预测下一个单词,但轮流发言涉及到从对话更深层次的语境中汲取信息,也就是说,AI 可能无法真正理解对话的语境和意图。

研究人员表示,可以通过对大型语言模型进行预训练,使其在更大规模的自然口语语料库上进行训练,从而克服这些限制。然而,收集如此规模的数据来训练今天的 AI 模型仍然是一个重大挑战。与互联网上的书面内容相比,可用的对话录音和转录数量要少得多。